Les modèles de réseaux neuronaux profonds qui alimentent les applications d’apprentissage automatique les plus exigeantes d’aujourd’hui sont devenus si vastes et si complexes qu’ils repoussent les limites du matériel informatique électronique traditionnel.

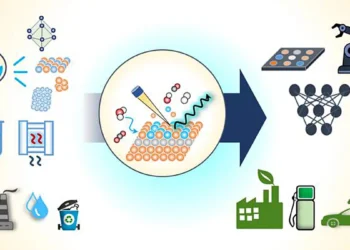

Le matériel photonique, qui peut effectuer des calculs d’apprentissage automatique à l’aide de la lumière, offre une alternative plus rapide et plus économe en énergie. Toutefois, il existe certains types de calculs de réseaux neuronaux qu’un dispositif photonique ne peut pas effectuer, ce qui nécessite l’utilisation d’une électronique hors puce ou d’autres techniques qui nuisent à la vitesse et à l’efficacité.

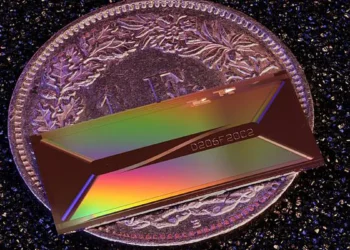

S’appuyant sur une décennie de recherche, des scientifiques du MIT et d’ailleurs ont mis au point une nouvelle puce photonique qui surmonte ces obstacles. Ils ont fait la démonstration d’un processeur photonique entièrement intégré, capable d’effectuer tous les calculs clés d’un réseau neuronal profond par voie optique sur la puce.

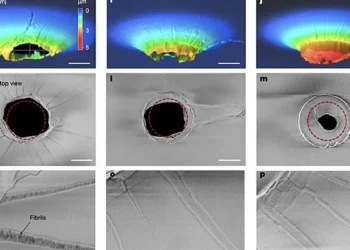

Le dispositif optique a été capable d’effectuer les calculs clés pour une tâche de classification d’apprentissage automatique en moins d’une demi-nanoseconde tout en atteignant une précision de plus de 92 % – des performances comparables à celles du matériel traditionnel.

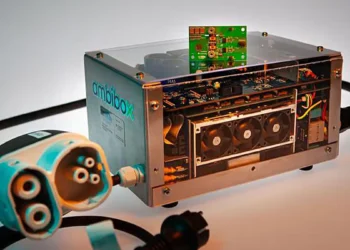

La puce, composée de modules interconnectés qui forment un réseau neuronal optique, est fabriquée à l’aide de procédés de fonderie commerciaux, ce qui pourrait permettre la mise à l’échelle de la technologie et son intégration dans l’électronique.

À long terme, le processeur photonique pourrait permettre un apprentissage profond plus rapide et plus économe en énergie pour des applications exigeantes en termes de calcul, telles que le lidar, la recherche scientifique en astronomie et en physique des particules, ou les télécommunications à haut débit.

« Dans de nombreux cas, ce n’est pas seulement la performance du modèle qui compte, mais aussi la rapidité avec laquelle on peut obtenir une réponse. Maintenant que nous disposons d’un système de bout en bout capable de faire fonctionner un réseau neuronal en optique, à l’échelle de la nanoseconde, nous pouvons commencer à réfléchir à un niveau plus élevé d’applications et d’algorithmes », commente Saumil Bandyopadhyay, chercheur invité au sein du groupe Photonique quantique et IA du Laboratoire de recherche en électronique (RLE) et post-doctorant chez NTT Research.

L’apprentissage automatique par la lumière

Les réseaux neuronaux profonds sont composés de nombreuses couches interconnectées de nœuds, ou neurones, qui agissent sur les données d’entrée pour produire une sortie. L’une des opérations clés d’un réseau neuronal profond consiste à utiliser l’algèbre linéaire pour effectuer une multiplication matricielle, qui transforme les données lorsqu’elles sont transmises d’une couche à l’autre.

Mais en plus de ces opérations linéaires, les réseaux neuronaux profonds effectuent des opérations non linéaires qui aident le modèle à apprendre des modèles plus complexes. Les opérations non linéaires, comme les fonctions d’activation, permettent aux réseaux neuronaux profonds de résoudre des problèmes complexes.

En 2017, le groupe d’Englund, ainsi que des chercheurs du laboratoire de Marin Soljačić, professeur de physique Cecil et Ida Green, ont fait la démonstration d’un réseau neuronal optique sur une seule puce photonique qui pouvait effectuer une multiplication matricielle avec de la lumière.

Mais à l’époque, le dispositif ne pouvait pas effectuer d’opérations non linéaires sur la puce. Les données optiques devaient être converties en signaux électriques et envoyées à un processeur numérique pour effectuer des opérations non linéaires.

« La non-linéarité en optique est un véritable défi, car les photons n’interagissent pas facilement entre eux. Le déclenchement des non-linéarités optiques consomme donc beaucoup d’énergie, et il devient difficile de construire un système capable de le faire de manière évolutive », indique M. Bandyopadhyay.

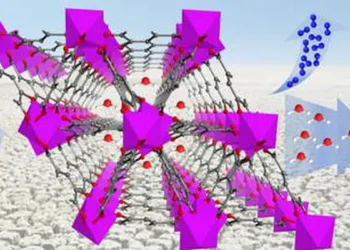

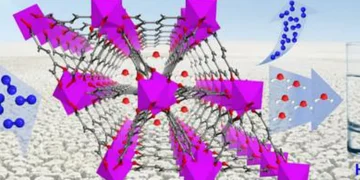

Ils ont relevé ce défi en concevant des dispositifs appelés unités de fonction optique non linéaire (NOFU), qui combinent l’électronique et l’optique pour mettre en œuvre des opérations non linéaires sur la puce.

Les chercheurs ont construit un réseau neuronal optique profond sur une puce photonique en utilisant trois couches de dispositifs qui effectuent des opérations linéaires et non linéaires.

Un réseau entièrement intégré

Au départ, leur système encode les paramètres d’un réseau neuronal profond dans la lumière. Ensuite, un réseau de séparateurs de faisceaux programmables, dont la démonstration a été faite dans l’article de 2017, effectue une multiplication matricielle sur ces entrées.

Les données sont ensuite transmises à des NOFU programmables, qui mettent en œuvre des fonctions non linéaires en siphonnant une petite quantité de lumière vers des photodiodes qui convertissent les signaux optiques en courant électrique. Ce processus, qui élimine la nécessité d’un amplificateur externe, consomme très peu d’énergie.

« Nous restons dans le domaine optique tout le temps, jusqu’à la fin, lorsque nous voulons lire la réponse. Cela nous permet d’obtenir une latence très faible », explique M. Bandyopadhyay.

Cette faible latence leur a permis d’entraîner efficacement un réseau neuronal profond sur la puce, un processus connu sous le nom d’entraînement in situ qui consomme généralement une énorme quantité d’énergie dans le matériel numérique.

« C’est particulièrement utile pour les systèmes qui traitent des signaux optiques dans le domaine, comme la navigation ou les télécommunications, mais aussi pour les systèmes qui veulent apprendre en temps réel », ajoute-t-il.

Le système photonique a atteint une précision de plus de 96 % lors des tests d’entraînement et de plus de 92 % lors de l’inférence, ce qui est comparable au matériel traditionnel. En outre, la puce effectue des calculs clés en moins d’une demi-nanoseconde.

« Ce travail démontre que le calcul – dans son essence, la mise en correspondance des entrées et des sorties – peut être compilé sur de nouvelles architectures de physique linéaire et non linéaire qui permettent une loi d’échelle fondamentalement différente du calcul par rapport à l’effort nécessaire », déclare M. Englund.

L’ensemble du circuit a été fabriqué à l’aide de la même infrastructure et des mêmes procédés de fonderie que ceux utilisés pour produire les puces informatiques CMOS. Cela pourrait permettre de fabriquer la puce à grande échelle, en utilisant des techniques éprouvées qui introduisent très peu d’erreurs dans le processus de fabrication.

La mise à l’échelle de leur dispositif et son intégration dans des systèmes électroniques réels, tels que des caméras ou des systèmes de télécommunications, constitueront un axe majeur des travaux futurs, indique M. Bandyopadhyay. En outre, les chercheurs souhaitent explorer les algorithmes qui peuvent exploiter les avantages de l’optique pour former les systèmes plus rapidement et avec une meilleure efficacité énergétique.

Légende illustration : Les chercheurs ont fait la démonstration d’un processeur photonique entièrement intégré capable d’effectuer tous les calculs clés d’un réseau neuronal profond de manière optique sur la puce, ce qui pourrait permettre un apprentissage profond plus rapide et plus économe en énergie pour des applications exigeantes en termes de calcul, telles que le lidar ou les télécommunications à haut débit.

M. Bandyopadhyay est rejoint dans cet article par Alexander Sludds ’18, MEng ’19, PhD ’23 ; Nicholas Harris PhD ’17 ; Darius Bunandar PhD ’19 ; Stefan Krastanov, un ancien chercheur du RLE qui est maintenant professeur adjoint à l’Université du Massachusetts à Amherst ; Ryan Hamerly, un chercheur invité au RLE et un chercheur principal à NTT Research ; Matthew Streshinsky, ancien responsable de la photonique du silicium chez Nokia, aujourd’hui cofondateur et PDG d’Enosemi ; Michael Hochberg, président de Periplous, LLC ; et Dirk Englund, professeur au département de génie électrique et d’informatique, chercheur principal du Quantum Photonics and Artificial Intelligence Group et du RLE, et auteur principal de l’article. La recherche est publiée aujourd’hui dans Nature Photonics.

Article : « Single-chip photonic deep neural network with forward-only training » – s41566-024-01567-z

Source MIT – auteur Adam Zewe – Traduction Enerzine.com

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.