Les dispositifs à base de fibres optiques ont connu un succès considérable dans le développement, la maturité et les applications étendues des technologies de communication et de détection par fibres optiques. Cependant, il est difficile de fonctionnaliser et de sensibiliser les fibres de silice ordinaires pour détecter et convertir le signal lumineux qui les traverse.

Dans cet article, nous explorons une solution potentielle pour résoudre ce problème en intégrant des dispositifs photoélectriques sur les fibres optiques.

Photodétecteurs tout-fibre

La construction de photodétecteurs tout-fibre en liant des matériaux bidimensionnels (2D) ou des métasurfaces aux extrémités des fibres optiques présente une grande photoresponsivité et une excellente compatibilité avec le système de fibres optiques.

Des films de graphène ou de CNT/graphène hybride ont également été intégrés sur des fibres en forme de D ou effilées, et l’amélioration de l’interaction lumière-matière contribue à la détection photoélectrique et à la modulation de phase.

Problèmes de modification et de suppression de la gaine de fibre

Malheureusement, la modification et la suppression de la gaine de fibre sont nécessaires dans ces dispositifs, ce qui détruit l’intégrité des fibres optiques et réduit leurs propriétés mécaniques.

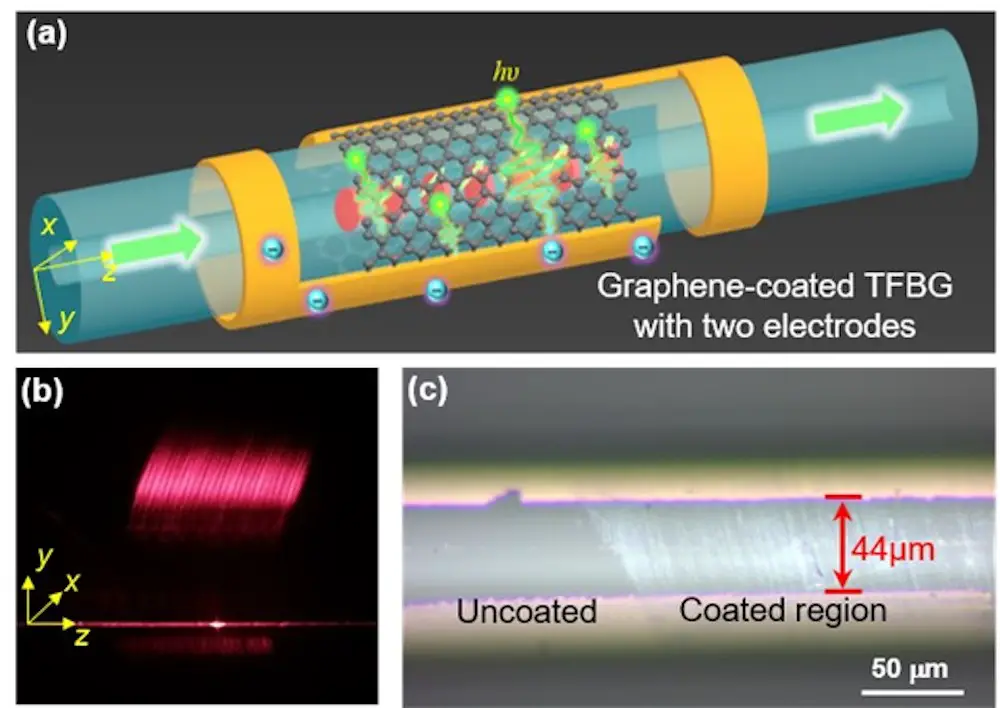

Les réseaux de Bragg inclinés sur fibre (TFBG) offrent une alternative en fournissant un champ évanescent fort à proximité de l’interface de la gaine de fibre pour absorber, moduler ou convertir le signal lumineux en signal électrique dans les fibres en intégrant des matériaux fonctionnels.

Dispositif photoélectrique à base de graphène et de TFBG

La combinaison du graphène et de la configuration tout-fibre offre une nouvelle opportunité pour réaliser des dispositifs photoélectriques tout-fibre intégrés et miniaturisés. Les auteurs de cet article dans Opto-Electronic Science rapportent la réalisation d’un dispositif optoélectronique à base de fibres assisté par une couche de graphène et deux électrodes symétriques pour les conversions photoélectriques et thermo-optiques induites électriquement.

Résultats expérimentaux

Le dispositif montre une réponse photoélectrique dépendante de la polarisation avec une responsivité allant jusqu’à 11,4 A/W, un courant de saturation d’environ 100 µA et une vitesse de réponse de 196 ms.

De plus, l’évolution du photocourant dépendant de la longueur d’onde permet l’analyse du spectre en peigne du TFBG et démontre une résolution spectrale supérieure à celle de la transmission balayée par un laser accordable.

Effet thermique induit électriquement

Lorsqu’un signal électrique est appliqué sur la couche de graphène, le spectre de transmission du TFBG présente un décalage global vers le rouge dû à l’effet de chauffage Joule. Le décalage spectral présente une réponse linéaire avec le courant carré, et la sensibilité atteint 2,167×104 nm/A².

Par ailleurs, le temps de réponse et le rapport d’extinction maximal du commutateur thermo-optique sont respectivement de 148 ms et 15 dB.

En synthèse

Ce travail offre une voie potentielle pour développer des dispositifs optoélectroniques multifonctionnels à base de fibres avec l’intégration de matériaux 2D. Grâce aux avantages du système tout-fibre, la propagation, la filtration, la modulation et la détection du signal lumineux peuvent être réalisées dans un dispositif à fibre sans perte d’intégration, ce qui est plus flexible que l’utilisation d’un système de lentilles et de couplage de fibres pour focaliser la source lumineuse dans un guide d’ondes sur puce.

Fig. 1. Dispositif photoélectrique TFBG intégré au graphène. (Image : Compuscript)