Matt Shipman

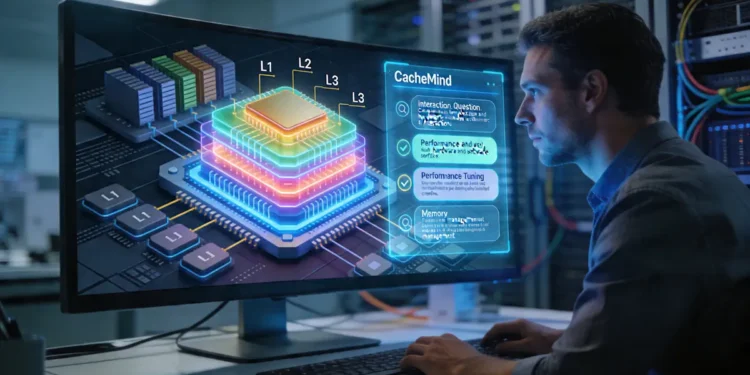

Des chercheurs de l’Université d’État de Caroline du Nord ont développé un nouvel outil assisté par IA qui aide les architectes informatiques à améliorer les performances des processeurs en optimisant la gestion de la mémoire. Cet outil, nommé CacheMind, est le premier simulateur d’architecture informatique capable de répondre à des questions interactives et arbitraires sur les interactions complexes matériel-logiciel.

Le nouvel outil se concentre sur les caches (antémémoires), des composants matériels ou logiciels d’un système qui stockent des données susceptibles d’être réutilisées rapidement – l’idée étant qu’il est plus rapide de récupérer des données depuis le cache que depuis le disque dur. Cependant, les caches ne peuvent stocker qu’une quantité limitée de données. Les architectes informatiques utilisent deux techniques complémentaires pour améliorer les performances du cache : le préchargement améliore les performances en récupérant sélectivement dans le cache les données les plus susceptibles d’être utilisées avant qu’elles ne soient nécessaires ; et les politiques de remplacement de cache sont des algorithmes qui déterminent quelles données doivent être supprimées du cache pour en charger de nouvelles.

« Optimiser une politique de remplacement de cache est un défi, car il peut être difficile de déterminer quels blocs de données seront utilisés dans un avenir immédiat », explique Kaushal Mhapsekar, premier auteur de l’article sur ces travaux et doctorant à la NC State. « Pour y parvenir efficacement, il faut bien comprendre les détails fins de ce qui se passe dans le système, comme quelles instructions dépendent de données qui ne sont pas dans le cache. »

« Actuellement, les architectes informatiques utilisent des simulateurs pour estimer comment les modifications apportées à une politique de remplacement de cache affecteront les performances du système », indique Azam Ghanbari, co-auteur de l’article et également doctorant à la NC State. « Les sorties de ces simulateurs sont des statistiques agrégées sur l’utilisation des blocs de données. Cependant, ces sorties omettent ces détails fins qui sont essentiels pour identifier les meilleurs moyens d’améliorer la politique de remplacement de cache. »

En résumé, les approches actuelles pour améliorer les performances du cache suivent une méthode d’essais et d’erreurs : exécuter une simulation, examiner les chiffres, essayer une modification du préchargeur ou de la politique de remplacement, relancer la simulation, puis voir si les choses se sont améliorées.

« Une meilleure approche consiste à analyser ce qui se passe, identifier les modèles qui pourraient être améliorés, déterminer ce qui cause ces modèles, puis mettre en œuvre une correction », souligne Samira Mirbagher Ajorpaz, auteure correspondante de l’article et professeure adjointe en génie électrique et informatique à la NC State. « CacheMind a été développé pour aider à cela – il utilise le raisonnement causal, et non l’essai-erreur, pour améliorer la gestion de la mémoire. »

« Notre objectif était de développer un outil convivial qui pourrait aider les architectes informatiques à comprendre non seulement ce qui se passe à l’intérieur de leurs processeurs, mais aussi pourquoi », explique Mirbagher Ajorpaz. « Et il est important de noter que CacheMind permet des questions arbitraires qui assistent le raisonnement humain, permettant à l’IA de travailler aux côtés des humains dans la conception des CPU. Construire un tel outil était un défi, car les modèles d’IA conventionnels s’entraînent sur des questions-réponses pour répondre à des questions spécifiques, pas arbitraires. »

Le résultat final est un « outil conversationnel » qui permet aux architectes de poser des questions en langage naturel comme, « Pourquoi l’accès à la mémoire associé au PC X provoque-t-il plus d’évictions ? »

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

Dans les tests de validation de principe, CacheMind a amélioré à la fois le taux de succès du cache (hit rate) et l’accélération (speedup) dans tous les cas de test.

Parce que CacheMind est le premier outil basé sur un LLM conçu spécifiquement pour traiter les politiques de remplacement de cache, les chercheurs ont également créé un benchmark pouvant être utilisé pour comparer les performances de CacheMind à celles des futurs modèles conçus pour effectuer la même tâche.

« Nous avons créé CacheMindBench, qui se compose de 100 requêtes sur les politiques de remplacement de cache avec des réponses vérifiées », précise Bita Aslrousta, co-auteure de l’article et doctorante à la NC State. « CacheMind est le premier outil de ce type, mais ce ne sera pas le dernier. CacheMindBench devrait être utile pour suivre les performances des futures avancées dans ce domaine. »

« Cet article se concentre sur les politiques de remplacement de cache, qui est l’étude de cas que nous avons utilisée pour démontrer le potentiel de CacheMind », ajoute Mirbagher Ajorpaz. « Mais les applications de CacheMind et de CacheMindBench s’étendent à des questions plus larges d’architecture informatique. »

« CacheMindBench est le premier benchmark de raisonnement LLM en microarchitecture. Les benchmarks de raisonnement vérifiés sont essentiels car ils servent d’exemples donnés aux LLM, ce qui permet l’apprentissage contextuel. L’approche d’apprentissage automatique connue sous le nom de « few-shot learning » permet aux LLM de répondre à des questions arbitraires et de se baser sur un contexte. Notre benchmark donne aux LLMs le contexte dont ils ont besoin pour mimer le raisonnement. Et cela leur permet d’effectuer un raisonnement de type humain dans des domaines sur lesquels ils n’ont pas été pré-entraînés. CacheMind fonctionne en plug and play sur toute nouvelle configuration, nouvelle question ou nouveau défi de charge de travail logiciel sans avoir à être entraîné spécifiquement dessus. »

L’article évalué par les pairs, « CacheMind: From Miss Rates to Why – Natural-Language, Trace-Grounded Reasoning for Cache Replacement », a été présenté le 25 mars à la Conférence internationale ACM sur le support architectural des langages de programmation et des systèmes d’exploitation (ASPLOS) à Pittsburgh, en Pennsylvanie.

Article : CacheMind: From Miss Rates to Why – Natural-Language, Trace-Grounded Reasoning for Cache Replacement – Méthode : Experimental study – DOI : Lien vers l’étude

Source : NCSU