La consommation électrique des systèmes d’IA et des centres de données aux États-Unis est extraordinaire à tous points de vue. L’Agence internationale de l’énergie estime que l’IA et les centres de données américains ont utilisé environ 415 térawattheures d’électricité en 2024, soit plus de 10 % de la production énergétique nationale cette année-là, et cette consommation devrait doubler d’ici 2030.

Cherchant à éviter cette trajectoire insoutenable de consommation d’énergie, des chercheurs de la School of Engineering ont développé une preuve de concept pour des systèmes d’IA efficaces qui pourraient utiliser 100 fois moins d’énergie que les systèmes actuels, tout en fournissant des résultats plus précis sur les tâches.

L’approche développée dans le laboratoire de Matthias Scheutz, Karol Family Applied Technology Professor, utilise l’IA neuro-symbolique, une combinaison de l’IA par réseaux neuronaux conventionnels avec un raisonnement symbolique similaire à la façon dont les humains décomposent les tâches et les concepts en étapes et catégories. Cette recherche sera présentée à la Conférence internationale sur la robotique et l’automatisation à Vienne en mai et publiée dans les actes de la conférence.

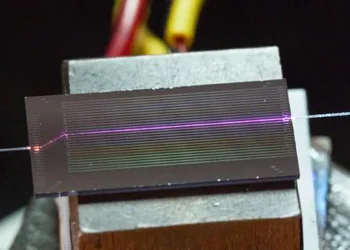

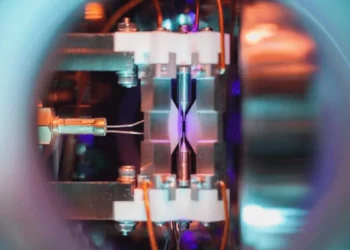

Scheutz et son équipe concentrent leur travail sur les robots interagissant avec les humains. Ainsi, les technologies d’IA qu’ils emploient ne sont pas du type des grands modèles de langage (LLM) basés sur écran comme ChatGPT et Gemini, par exemple. Au lieu de cela, ils étudient les modèles visio-langage-action (VLA), qui sont une extension des LLM avec des capacités visuelles et motrices pour les robots. Ces modèles utilisent des entrées caméra et langage et répondent en générant des actions dans le monde réel, comme bouger les roues, les jambes, les bras et les doigts d’un robot.

Avec les approches VLA conventionnelles et gourmandes en ressources, si un robot devait empiler des blocs en une simple tour, le système pourrait scanner l’environnement, identifier l’emplacement des blocs, leur forme et leur orientation, et interpréter l’instruction de placer chaque bloc l’un sur l’autre. La tentative de le faire pourrait conduire, par exemple, à mal interpréter la forme d’un bloc à cause des ombres, à mal placer un bloc, ou à empiler les blocs de manière à ce qu’ils basculent.

Pour reprendre l’analogie avec les LLM, les tentatives ratées par les robots sont similaires à un chatbot fournissant des résultats inexacts, voire totalement faux, en texte ou en images. Des exemples célèbres incluent l’invention de cas juridiques imaginaires pour des mémoires ou la représentation de personnes avec six doigts.

Le raisonnement symbolique est plus efficace que l’approche conventionnelle, élaborant des stratégies de planification plus générales basées sur des règles de casse-tête et des catégories abstraites comme la forme des blocs et les centres de masse.

Comment les systèmes neuro‑symboliques fonctionnent mieux

Comme un LLM, les modèles VLA agissent sur des résultats statistiques provenant de grands ensembles d’entraînement de scénarios similaires, mais cela peut conduire à des erreurs, explique Scheutz. Un VLA neuro-symbolique peut appliquer des règles qui limitent la quantité d’essais et d’erreurs pendant l’apprentissage et aboutir à une solution bien plus rapidement. Non seulement il accomplit la tâche beaucoup plus vite, mais le temps passé à entraîner le système est considérablement réduit.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

Dans des tests utilisant le casse-tête classique de la Tour de Hanoï, le système VLA neuro‑symbolique a obtenu un taux de réussite de 95 %, contre 34 % pour les VLA standard. Pour une version plus complexe du casse-tête que le robot n’avait jamais vue à l’entraînement, le système neuro-symbolique a obtenu un taux de réussite de 78 %, tandis que les VLA standard ont échoué à chaque tentative.

Le système neuro-symbolique a pu être entraîné en seulement 34 minutes, tandis que le modèle VLA standard a pris plus d’un jour et demi. Significativement, l’entraînement du modèle neuro-symbolique n’a utilisé que 1 % de l’énergie nécessaire pour entraîner un modèle VLA, et les économies d’énergie se sont poursuivies pendant l’exécution des tâches, le modèle neuro-symbolique n’utilisant que 5 % de l’énergie requise pour faire fonctionner le VLA.

Scheutz établit des parallèles avec les LLM familiers comme ChatGPT ou Gemini. Ces systèmes essaient simplement de prédire le mot ou l’action suivante dans une séquence, mais cela peut être imparfait, et ils peuvent produire des résultats inexacts ou des hallucinations. Leur dépense énergétique est souvent disproportionnée par rapport à la tâche. Par exemple, lorsque vous effectuez une recherche sur Google, le résumé IA en haut de la page consomme jusqu’à 100 fois plus d’énergie que la génération des listes de sites web.

Avec l’explosion de la demande des utilisateurs pour les systèmes d’IA et leur intégration dans les applications industrielles, il existe une course aux armements concurrentielle pour des systèmes de centres de données toujours plus grands, des installations dont la consommation électrique peut atteindre des centaines de mégawatts, bien plus que ce qui est généralement nécessaire pour alimenter de petites villes.

Les chercheurs concluent que les LLM et VLA actuels, malgré leur popularité, pourraient ne pas être la bonne base pour une IA fiable et écoénergétique, et pourraient nous amener droit contre un mur de limitations de ressources. Au lieu de cela, ils suggèrent que l’IA hybride neuro‑symbolique pourrait offrir une voie plus durable et fiable pour l’avenir.

Source : TUFT U.