Un robot capable de localiser des objets égarés sur commande – c’est la dernière innovation de l’Université Technique de Munich (TUM). Il combine les connaissances d’Internet avec une carte spatiale de son environnement pour trouver efficacement les objets recherchés.

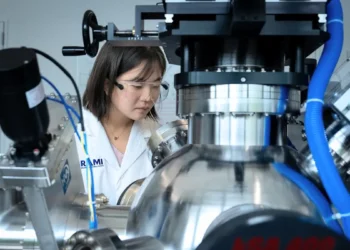

Le nouveau robot du Laboratoire de Systèmes d’Apprentissage et de Robotique de la TUM, dirigé par le Prof. Angela Schoellig, ressemble à un manche à balai sur roues avec une caméra montée au sommet. C’est l’un des premiers robots qui intègre non seulement la compréhension d’image mais l’applique aussi à une tâche clairement définie.

Pour retrouver une paire de lunettes égarée dans la cuisine, par exemple, le robot doit observer les alentours et construire une image tridimensionnelle de la pièce. La caméra fournit d’abord des images bidimensionnelles, mais ces pixels contiennent aussi des informations de profondeur. Cela crée une carte spatiale de l’environnement précise au centimètre et constamment mise à jour. Un ordinateur portable fournit également au robot des informations sur les objets visibles dans l’image et leur signification pour les humains.

« Nous avons appris au robot à comprendre son environnement », explique le Prof. Angela Schoellig. La directrice du Laboratoire de Robotique de la chaire de Sécurité, Performance et Fiabilité des Systèmes d’Apprentissage de la TUM vise à développer des robots capables de naviguer de manière autonome dans n’importe quel environnement. Les robots humanoïdes travaillant en usine ou les robots dans les soins à domicile nécessitent cette compréhension fondamentale nouvellement développée, qui, comme le souligne Schoellig, « est importante pour tous les robots qui se déplacent dans des espaces en constante évolution ».

Des connaissances d’Internet traduites dans le langage du robot

Le robot comprend donc qu’une table ou un rebord de fenêtre peut servir à poser temporairement une paire de lunettes, tandis qu’une plaque de cuisson ou un évier ne sont pas adaptés à cet usage. « Le modèle de langage saisit les relations entre les objets et nous convertissons ces informations dans le langage du robot », détaille le Prof. Schoellig. Des nombres à deux chiffres apparaissent sur la carte tridimensionnelle de l’environnement, recalculant constamment la probabilité que l’objet recherché s’y trouve. Selon les résultats de la recherche, le robot fouille ensuite les emplacements probables près de 30 % plus efficacement que s’il cherchait au hasard dans toute la pièce. L’intelligence artificielle est utilisée de deux manières : d’une part dans la reconnaissance d’image et d’autre part via l’utilisation d’un modèle de langage.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

Une autre capacité spéciale du robot : il mémorise les images précédentes et peut les comparer avec de nouvelles images de son environnement. Si un nouvel objet apparaît soudainement dans la cuisine, il reconnaît le changement avec un degré de certitude élevé (95 %) et marque ces zones comme emplacements de recherche « hautement probables ».

Prochaine étape : rechercher derrière les portes des placards

Dans une prochaine étape, la scientifique de la TUM et membre du conseil d’administration du Munich Institute of Robotics and Machine Intelligence (TUM MIRMI) souhaite également rechercher des objets qui se trouvent dans un tiroir ou derrière une porte. Pour cela, cependant, le robot ne devra pas seulement puiser dans les connaissances d’Internet mais aussi interagir avec son environnement. Des bras et des mains robotisés devront ouvrir un placard et déterminer s’il s’ouvre vers le haut ou sur le côté et comment saisir au mieux la poignée. Cela permettra au robot de chercher même dans des espaces fermés comme des placards ou des tiroirs.

Article : Where Did I Leave My Glasses? Open-Vocabulary Semantic Exploration in Real-World Semi-Static Environments – Journal : IEEE Robotics and Automation Letters – Méthode : Case study – DOI : Lien vers l’étude

Source : TUM