En pleine effervescence autour des usages créatifs de l’intelligence artificielle, Nvidia vient de franchir une nouvelle étape avec son « AI Blueprint for 3D object generation » ou autrement dit son « Plan d’IA pour la génération d’objets en 3D » qui permet à n’importe quel artiste de produire jusqu’à vingt objets 3D en partant d’une seule phrase descriptive.

Avec l’intégration du microservice Microsoft Trellis et une accélération promise de 20%, l’initiative veut bouleverser les temps de prototypage dans le jeu vidéo, l’animation ou le design produit. Derrière l’effet « extraordinaire » procuré dans l’immédiat, c’est toute une chaîne de production numérique qui pourrait se retrouver simplifiée.

Un portefeuille clé-en-main pour la génération 3D

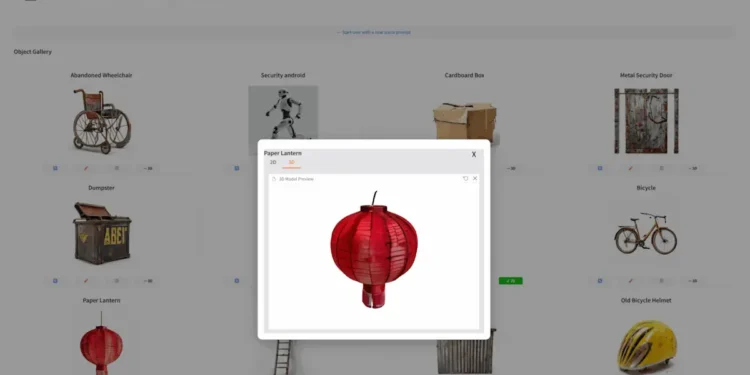

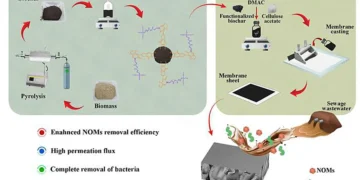

Nvidia rebaptise « AI Blueprint » une série de workflows préconfigurés destinés à démocratiser l’usage des modèles génératifs dans les studios . Concrètement, l’utilisateur saisit une idée de type « appartement rétro-futuriste de nuit ». L’outil va d’abord s’appuyer sur un grand modèle de langage (le Llama 3.1 8B, optimisé maison) pour ensuite proposer 20 objets susceptibles de peupler la scène. Chaque suggestion est matérialisée par une image haute résolution fournie par le framework Nvidia Sana, avant d’être convertie en véritable mesh 3D.

La conversion de l’aperçu 2D en modèle 3D repose sur Microsoft Trellis, une recherche là aussi maison de l’éditeur de Redmond qui est désormais encapsulée dans un microservice NIM (Nvidia Inference Microservice). L’optimisation sous PyTorch réduit d’environ six secondes la génération individuelle . Sur un projet réunissant des centaines d’éléments, le gain cumulé promet des journées entières économisées, un argument majeur pour les indépendants comme pour les grands studios.

Saisissez une idée de scène simple (par exemple « marché nocturne » ou « journée ensoleillée à la plage »).

Vingt aperçus d’images seront générés automatiquement.

Remplacez les objets indésirables en cliquant sur l’icône d’actualisation située sous l’image.

Astuce : pour mieux contrôler l’image de remplacement, cliquez sur l’icône en forme de crayon située sous l’image afin de modifier l’invite d’origine.

Supprimez les objets indésirables en cliquant sur l’icône en forme de poubelle située sous l’image.

Convertissez des images individuelles à l’aide de l’icône « ->3D » située sous l’image.

Convertissez tous les aperçus en 3D à l’aide du bouton « Convertir tout en 3D » situé en bas.

Astuce : cliquez sur « Recommencer avec une nouvelle invite de scène » pour démarrer une nouvelle scène. Cela efface la progression actuelle, alors assurez-vous d’abord d’enregistrer.

Exportez les fichiers vers Blender à l’aide du bouton intégré en bas de la page pour continuer à affiner les modèles 3D.

Des instructions détaillées et les fichiers nécessaires sont disponibles sur NVIDIA Build et GitHub.

Un changement de paradigme pour artistes et développeurs

Traditionnellement, la phase de prototypage exige la création de modèles en faible nombre de polygones, temporaires, souvent voués à disparaître une fois la scène validée. En automatisant cette étape, Nvidia vise à libérer les artistes des tâches répétitives et à encourager l’itération rapide. Les objets produits peuvent être exportés directement vers Blender ou toute autre application 3D standard.

Au-delà du confort de production, l’annonce marque aussi un tournant dans la collaboration homme-machine. En effet, l’outil ne se contente plus de générer une image statique mais fournit des modèles prêts à animer, texturer ou imprimer en 3D. Les frontières entre concept art, modélisation et rendu continuent ainsi de s’estomper, laissant présager une hybridation toujours plus forte des métiers créatifs.

Des questions qui dépassent la prouesse technique

Reste la question de la propriété intellectuelle : si le modèle tire parti d’immenses corpus de données pour apprendre les formes et textures, quel cadre légal protège l’artiste final ou, au contraire, les créateurs dont les œuvres ont nourri l’algorithme ? Nvidia, prudent, se concentre sur la performance technique et renvoie aux bonnes pratiques de licence.

Mais l’irruption d’objets 3D générés dans les places de marché pourrait raviver le débat sur la traçabilité des contenus. Avec ce Blueprint (Plan d’IA), Nvidia confirme son ambition de bâtir un écosystème où les tâches laborieuses seront prises en charge par l’IA, laissant l’humain se concentrer sur la direction artistique. Les professionnels pourront juger sur pièce dès cette semaine, la solution étant distribuée via GitHub et démontrée lors du salon IFA de Berlin.

Une variété de modèles d’IA conçus par des experts, est déjà disponible, notamment le modèle d’IA pour l’IA générative guidée en 3D, et les microservices NIM.

Source : Nvidia

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.