À mesure que les assistants algorithmiques s’immiscent dans nos décisions quotidiennes, deux lignes de fracture se font jour : la dépendance cognitive et l’empreinte énergétique. Des travaux académiques récents montrent qu’un usage intensif de l’intelligence artificielle (IA) corrèle avec une baisse mesurable des capacités de raisonnement. Dans le même temps, l’expansion fulgurante des modèles génératifs alourdit la facture électrique des centres de données, jusqu’à rivaliser avec la consommation annuelle de pays entiers. Comment concilier confort intellectuel instantané et sobriété numérique.

Un cerveau qui s’en remet trop à la machine

Les recherches menées par la SBS Swiss Business School mettent en évidence une corrélation négative significative (r = -0,68) entre l’usage fréquent d’outils d’IA et les scores de pensée critique. Le phénomène, qualifié de « déchargement cognitif », décrit la tendance à déléguer les tâches de réflexion à un agent artificiel plutôt qu’à mobiliser ses propres ressources. Une méta-analyse en libre accès détaille même une médiation : plus l’utilisateur s’en remet à l’IA, plus il externalise sa charge mentale, et moins il exerce son esprit critique.

Le Institut de technologie du Massachusetts a poussé l’expérience sur plusieurs mois : des étudiants ayant rédigé tous leurs essais avec ChatGPT présentent, une fois l’exercice terminé, une connectivité cérébrale affaiblie et une mémoire de travail dégradée, des effets persistants même après l’arrêt de l’outil. De quoi nourrir les inquiétudes des pédagogues, qui redoutent une génération de « penseurs sous-traités ».

Une dynamique psychologique ambivalente

Paradoxalement, les mêmes études soulignent que les algorithmes accélèrent la productivité : réponses instantanées, résumés fulgurants, brouillons structurés. Ce gain d’efficacité s’accompagne toutefois d’un « confort dangereux » ; l’IA élimine la « lutte productive », ce temps de latence où l’on tâtonne, essentiel au raisonnement profond. Lorsque la solution surgit trop vite, l’utilisateur ne cultive plus l’esprit de doute ; il valide la proposition, souvent sans la questionner.

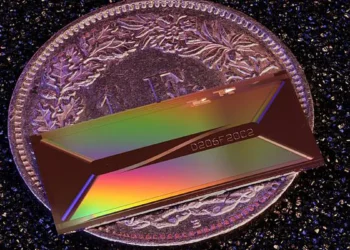

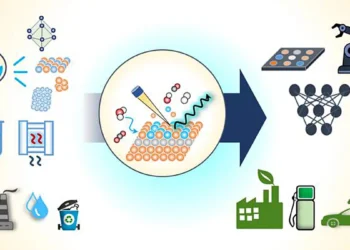

Si le coût cognitif inquiète les pédagogues, le coût carbone préoccupe les ingénieurs. Selon l’Agence internationale de l’énergie, une interaction avec un chatbot génératif consommerait jusqu’à dix fois plus d’électricité qu’une recherche web classique. La montée en puissance des puces spécialisées (GPU, TPU) et le refroidissement intensif des data centers tirent la consommation mondiale vers le haut : l’IEA prévoit entre 160 TWh et 590 TWh supplémentaires d’ici 2026 pour les centres de données, cryptomonnaies et IA réunis.

À horizon 2030, certains experts n’excluent pas que ces infrastructures captent 20% de l’électricité planétaire.

Des pistes d’atténuation encore balbutiantes

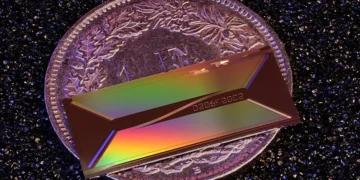

Plusieurs laboratoires explorent des modèles « frugaux » capables d’offrir 80% des performances pour une fraction de l’énergie, via la quantification des poids ou l’entraînement sur des jeux de données mieux curés. Parallèlement, les chercheurs en sciences cognitives plaident pour une hygiène mentale, c’est à dire alterner des phases assistées avec des phases sans IA dans le but de conserver des rituels de réflexion autonome et intégrer des garde-fous pédagogiques.

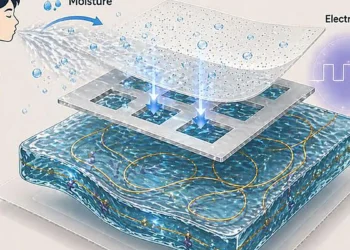

Les plateformes, elles, multiplient les promesses de neutralité carbone et de refroidissement à l’eau de mer, tout en continuant à déployer toujours plus de paramètres. Le pari d’un développement soutenable repose donc sur deux conditions : des architectures sobres et des utilisateurs qui restent maîtres de leurs propres raisonnements.

L’IA n’est ni l’ennemie ni la panacée : elle révèle, par contraste, nos forces et nos paresses cognitives. Si ses bénéfices en matière d’efficacité sont indéniables, ses effets collatéraux comme l’affaiblissement de la pensée critique et la pression énergétique imposent une vigilance accrue.

References

Jackson, J. 2025, January 13. Increased AI use linked to eroding critical thinking skills. Phys.org. https://phys.org/news/2025-01-ai-linked-eroding-critical-skills.html.

Lee, H.-P., A. Sarkar, L. Tankelevitch, I. Drosos, S. Rintel, R. Banks, and N. Wilson. 2025. The impact of generative AI on critical thinking: Self-reported reductions in cognitive effort and confidence effects from a survey of knowledge workers. In CHI Conference on Human Factors in Computing Systems (CHI ’25), April 26–May 1, 2025, Yokohama, Japan. ACM. https://www.microsoft.com/en-us/research/wp-content/uploads/2025/01/lee_2025_ai_critical_thinking_survey.pdf

Article : « AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking » – DOI:10.3390/soc15010006

Source principale : NSTA

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.