Une étude de l’Université Bar-Ilan révèle que les réseaux de neurones artificiels contredisent le principe physique « More is Different » formulé par Philip Anderson en 1972. Alors que les systèmes physiques tendent vers l’homogénéité, l’IA développe une spécialisation croissante de ses composants, ouvrant la voie à des architectures plus efficaces.

Les réseaux de neurones artificiels fonctionnent selon des principes radicalement différents de ceux qui régissent les systèmes physiques classiques. La découverte, issue des travaux du professeur Ido Kanter de l’Université Bar-Ilan, remet en question des décennies de pensée scientifique et pourrait transformer notre approche de la conception des systèmes d’intelligence artificielle.

Le paradoxe de la spécialisation

La recherche s’appuie sur un concept formulé en 1972 par le physicien Philip Anderson, lauréat du prix Nobel. Son principe « More is Different » postule que lorsque de nombreux éléments se combinent, des propriétés nouvelles et irréductibles peuvent émerger. Cependant, l’étude de Kanter démontre que la physique et l’intelligence artificielle se situent aux antipodes de cette idée.

Dans les systèmes physiques comme les aimants désordonnés, l’information contenue dans un composant reste essentiellement identique à celle contenue dans plusieurs éléments. « L’ajout de composants supplémentaires n’augmente pas de manière significative l’information totale sur l’état du système », explique le chercheur. Ce phénomène, qu’il qualifie de « More is the Same », contraste fortement avec le comportement observé dans les réseaux de neurones.

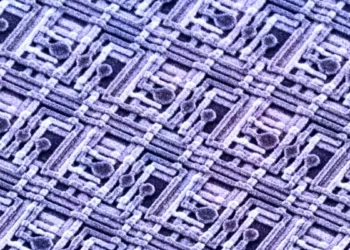

À mesure que ces systèmes apprennent, leurs unités internes – les nœuds – développent une spécialisation progressive. Chaque nœud assume des rôles distincts comme la reconnaissance de motifs spécifiques et l’identification de caractéristiques linguistiques. La division du travail signifie que chaque nœud supplémentaire apporte de nouvelles informations, et les capacités combinées du système dépassent véritablement la somme de ses parties.

Implications pour les neurosciences

La recherche s’étend bien au-delà de l’intelligence artificielle pour éclairer le fonctionnement du cerveau humain. En s’appuyant sur des données expérimentales concernant l’apprentissage dendritique – un mécanisme alternatif à la plasticité synaptique – Kanter suggère que le cerveau pourrait s’appuyer sur des neurones plus spécialisés et plus riches en informations qu’on ne le pensait auparavant.

La perspective ouvre de nouvelles voies pour comprendre comment l’information est traitée et stockée dans les réseaux neuronaux biologiques. Elle remet en question l’hypothèse selon laquelle les neurones fonctionneraient de manière relativement homogène, proposant plutôt un modèle où chaque unité développerait des compétences spécifiques au fil de l’apprentissage.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

Conséquences pour l’industrie de l’IA

Les conclusions de l’étude ont des implications pratiques importantes pour le développement des systèmes d’intelligence artificielle. Depuis plusieurs années, l’approche dominante dans l’industrie a consisté à augmenter systématiquement la taille des modèles, en ajoutant toujours plus de paramètres et en utilisant des volumes croissants de données d’entraînement.

Les travaux de Kanter suggèrent que la course à la taille pourrait être réévaluée. Comprendre comment les nœuds interagissent et se différencient pourrait s’avérer aussi important, voire plus déterminant, que la simple augmentation des capacités computationnelles. « Même un seul nœud au sein d’un modèle de langage peut contenir des informations significatives sur la tâche globale du modèle », précise le chercheur.

Cette perspective pourrait orienter les développeurs vers des architectures plus petites mais plus efficaces, où l’optimisation des interactions entre composants spécialisés prendrait le pas sur l’accumulation brute de ressources computationnelles.

Un pont entre disciplines

L’étude se présente comme une tentative de rapprochement entre deux domaines traditionnellement séparés : la physique théorique et l’informatique. L’approche interdisciplinaire permet d’éclairer des questions fondamentales sur la nature de l’information et de l’intelligence, qu’elle soit artificielle ou biologique.

La recherche suggère que les principes régissant l’émergence de propriétés complexes dans les systèmes artificiels pourraient différer fondamentalement de ceux observés dans le monde physique. Cette distinction ouvre la voie à une compréhension plus nuancée de ce qui constitue véritablement l’intelligence, au-delà des simples métaphores inspirées de la biologie ou de la physique.

Article : « More is Different in AI—More is the Same in Physics » – DOI : 10.1016/j.physa.2026.131534