Paul Caillon, Université Paris Dauphine – PSL et Alexandre Allauzen, Université Paris Dauphine – PSL

DeepSeek défraye la chronique en proposant un modèle dont les performances seraient comparables à celles des modèles préexistants, pour un coût très réduit en termes de puissance de calcul et de données, et donc une consommation énergétique moindre. Quand on sait que Microsoft a indiqué une hausse de 29,1 % d’émission de carbone sur l’année 2023 et que différentes grandes entreprises du numérique investissent dans des capacités de production d’électricité, le tout en lien avec l’essor de l’IA générative, l’enjeu est de taille. Pourquoi l’IA générative consomme-t-elle tant ? Décryptage.

Les grands modèles de langage (Large Language Models ou LLM), comme ChatGPT (OpenAI), Gemini (Google/DeepMind) ou encore les modèles génératifs d’images comme Midjourney, sont devenus en très peu de temps des outils incontournables avec des usages qui ne cessent de s’amplifier et de se diversifier. Il est vrai que la fluidité des échanges avec ChatGPT impressionne, et que les promesses de développement sont enthousiasmantes.

Néanmoins, ces promesses cachent des coûts de calcul, et donc énergétiques, considérables. Or, aujourd’hui l’idée dominante dans l’industrie des modèles génératifs est : « Plus grand est le modèle, mieux c’est. » Cette compétition s’accompagne d’une croissance de la consommation énergétique et, donc, de l’empreinte écologique qui ne peut plus être ignorée et qui questionne quant à sa pérennité et sa viabilité pour la société.

Pourquoi un tel coût ?

Un modèle génératif de texte comme un chatbot est un ensemble de paramètres numériques ajustés à partir de données pour accomplir une tâche spécifique. L’architecture dominante s’appuie sur les « transformers ».

Les transformers prennent une séquence en entrée, par exemple un prompt (soit votre question), pour la transformer numériquement. En empilant les couches de transformers, le modèle multiplie ces transformations afin de construire la réponse en prolongeant son entrée. Cet empilement de couches confère au modèle son efficacité et fait croître le nombre de paramètres. C’est pourquoi un modèle tel que GPT-4 contient au moins 1 tera (1 000 milliards) de paramètres et nécessite donc au moins 2 tera octets (To) de mémoire vive pour être utilisable.

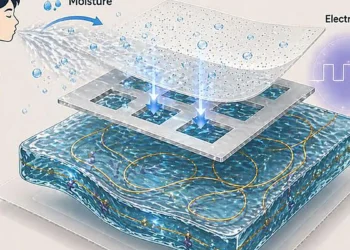

Que ce soit pour l’entraînement, pour le stockage des données et des paramètres, ou pour le calcul d’une réponse, des infrastructures de calcul de plus en plus puissantes sont donc indispensables. En d’autres termes, contrairement à ce que l’on croit souvent, ce n’est pas juste pour entraîner le modèle que ces techniques sont très coûteuses.

Des données émerge la « connaissance »

Avant tout, un modèle génératif doit être « appris ». Pour cela des données (textes, images, sons, etc.) lui sont présentées à maintes reprises afin d’ajuster ses paramètres. Plus il y a de paramètres, plus la phase d’apprentissage est coûteuse en données, mais aussi en temps et en énergie.

Ainsi, pour un LLM (grand modèle de langage), on parle par exemple de l’ordre de la dizaine de trillions de données (environ 10 trillions pour GPT-4 et 16 trillions pour Gemini) et aux alentours de trois mois de préapprentissage sur environ 20 000 puces A100 de NVIDIA pour le dernier-né d’OpenAI. Ces modèles les plus performants sont en fait une combinaison de plusieurs énormes modèles (les « Mixture of Experts »), GPT-4 étant ainsi le résultat de 16 experts de 110 milliards de paramètres, selon les rares informations disponibles.

Après cette phase d’apprentissage, le modèle est déployé afin de répondre aux utilisateurs dans une phase dite d’« inférence ». Pour faire face à la demande (ces systèmes construits pour répondre à plusieurs personnes en même temps) avec un temps de réponse satisfaisant, le modèle est alors dupliqué sur différents clusters de calcul. Un article de recherche constate également que les architectures génératives polyvalentes consomment significativement plus d’énergie à l’inférence que les systèmes spécifiques à une tâche, même à taille de modèle équivalente.

Ce survol des besoins en termes de calcul donne une idée des ordres de grandeur qui se cachent derrière nos interactions — qui semblent si rapides et efficaces — avec ces énormes modèles. Il permet surtout de poser différemment la question de l’évaluation de ces modèles, en y incluant la question de la soutenabilité en termes énergétiques et écologiques. Des travaux récents proposent ainsi un modèle pour évaluer les impacts environnementaux de la fabrication des cartes graphiques et une analyse multicritère des phases d’entraînement et d’inférence des modèles d’apprentissage automatique.

Obsolescence et frugalité

Ainsi les grands modèles génératifs nécessitent des infrastructures matérielles colossales.

Au-delà de considérations économiques, il a été montré que passé un certain point, les gains de performances ne justifient pas une telle explosion du nombre de paramètres. Toutes les applications ne nécessitent pas d’énormes modèles et des approches plus modestes peuvent être aussi performantes, plus rapides et moins coûteuses.

Sur le plan environnemental, l’apprentissage et l’inférence de modèles massifs ont un coût énergétique qui nécessitent réflexion. Les travaux de certains auteurs soulignent la complexité de mesurer avec précision l’empreinte carbone de ces grands modèles, tout en montrant leur impact considérable : 50,5 tonnes équivalent CO2 (CO2 eq) pour un modèle de 176 milliards de paramètres, appris en 2023… et pratiquement considéré comme obsolète aujourd’hui. Pour rappel, si un Français moyen rejette actuellement environ 10 tonnes CO2 eq par an, l’objectif à l’horizon 2050 pour respecter l’engagement des accords de Paris est d’environ 2 tonnes CO₂ eq par Français et par an.

Quant à la phase d’inférence (ou d’utilisation, quand on pose une question à GPT), lorsqu’elle est réalisée des millions de fois par jour, comme c’est le cas pour un assistant conversationnel, elle peut engendrer un coût énergétique considérable, parfois bien supérieur à celui de l’entraînement.

Ainsi, un outil développé en 2019 a permis d’estimer qu’une inférence de ChatGPT 3.5 produisait environ 4,32 grammes de CO2.

À l’heure où les assistants conversationnels sont peut-être en passe de remplacer les moteurs de recherche standards (Google, Bing, Qwant), la question de son utilisation se pose, car ces derniers ont un coût 10 à 20 fois moindre (0,2 gramme de CO2 la recherche, d’après Google).

Enfin, la concentration de pouvoir entre quelques acteurs disposant des ressources nécessaires pour développer ces modèles — data centers, données, compétences — pose des problèmes scientifiques en limitant la diversité des recherches, mais aussi stratégiques et politiques.

Les recherches en IA frugale

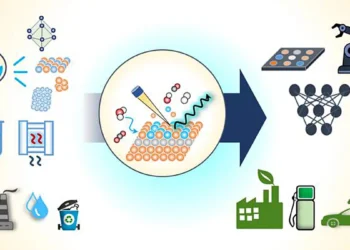

La frugalité consiste à se fixer dès le départ une enveloppe de ressources (calcul, mémoire, données, énergie) et à concevoir des modèles capables de s’y adapter. L’idée n’est pas de sacrifier les performances, mais de privilégier la sobriété : optimiser chaque étape, du choix de l’architecture à la collecte des données, en passant par des méthodes d’apprentissage plus légères, afin de réduire l’empreinte environnementale, d’élargir l’accès à l’IA et de favoriser des applications réellement utiles.

La recrudescence de travaux de recherche sur ce thème illustre la volonté de penser l’IA sous l’angle de la sobriété. Il s’agit ainsi de replacer la pertinence, l’impact sociétal et la soutenabilité au cœur de la recherche.

Concrètement, de nombreuses pistes émergent. Sur le plan de l’apprentissage, il s’agit d’explorer des alternatives algorithmiques au paradigme actuel, hérité du milieu des années 1980 et qui n’a jamais été remis en question alors même que les quantités de données et la puissance de calcul n’ont plus rien à voir avec celles qui prévalaient aux débuts de ces modèles.

Ainsi, au-delà des optimisations techniques, une réflexion méthodologique de fond s’impose, tant le contexte scientifique a évolué depuis les années 1980. Cette réflexion est au cœur, par exemple, du projet Sharp, financé par le programme France 2030. L’étude d’architectures plus compactes et spécialisées est également abordée avec le projet Adapting du même programme.

Les mathématiques appliquées peuvent jouer un rôle clé en proposant des « représentations parcimonieuses », des méthodes de factorisation, ou en optimisant l’usage de données faiblement annotées.

Ainsi, en travaillant avec des contraintes de ressources, ces recherches visent un développement en IA plus frugal et donc durable, ainsi que plus accessible, et indépendant de l’hyperconcentration du marché. Elles limitent les externalités négatives — environnementales, éthiques, économiques — liées à la course effrénée vers le gigantisme.

Mais pour atteindre ces objectifs, il est aussi important d’avancer sur les critères et les méthodes d’évaluations en IA : avec le paradigme dominant actuel, la dimension de frugalité peine encore à s’imposer, que ce soit du côté de la recherche ou industriel. Il ne faut d’ailleurs pas confondre la récente explosion des outils de DeepSeek avec de la frugalité, les coûts en calcul et en données étant eux aussi extrêmement élevés, avec des méthodes probablement éthiquement répréhensibles.

Ainsi, le monde académique doit mieux intégrer cette dimension afin d’améliorer la visibilité et la valorisation des travaux qui visent la frugalité.

L’IA que nous développons est-elle vraiment utile ?

La frugalité en IA n’est pas un simple concept, mais une nécessité face aux enjeux actuels. Les travaux récents sur son empreinte carbone illustrent l’urgence de repenser nos méthodes. Avant même d’envisager les manières de rendre l’IA plus sobre, il est légitime de se demander si l’IA que nous développons est vraiment utile.

Une approche plus frugale, mieux pensée et mieux orientée, permettra de construire une IA tournée vers le bien commun, s’appuyant sur des ressources maîtrisées, plutôt que sur la surenchère permanente en taille et en puissance de calcul.

Le projet PEPR Sharp IA (ANR-23-PEIA-0008) est soutenu par l’Agence nationale de la recherche (ANR), qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Paul Caillon, Docteur en intelligence artificielle , Université Paris Dauphine – PSL et Alexandre Allauzen, Professeur des Universités, Apprentissage Machine et Traitement automatique des langues, Université Paris Dauphine – PSL

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.