Pour une personne malentendante, une pièce remplie de gens qui parlent tous en même temps peut être un scénario cauchemardesque. Même avec des aides auditives, il est souvent difficile d’entendre la personne qui parle juste devant soi.

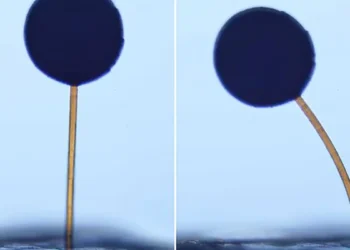

Nirbhay Narang ’25 a créé des lunettes intelligentes pour aider les gens à gérer cette situation. Ces lunettes utilisent l’intelligence artificielle pour fournir des transcriptions de conversations en temps réel, qui peuvent être consultées à la fois sur les lunettes et sur un téléphone.

« Je suis passionné par les interactions entre l’homme et l’ordinateur », commente Narang, étudiant en informatique au College of Arts & Sciences. « Je me considère comme un concepteur plutôt que comme un ingénieur et j’ai des amis qui travaillent dans le domaine des lunettes intelligentes depuis un certain temps. »

L’entreprise de Narang, AirCaps, prend les précommandes pour les lunettes légères. La technologie fonctionne en capturant une conversation, le son d’un film ou la voix d’un orateur à travers le microphone d’un téléphone, en la transcrivant immédiatement sur le téléphone et en envoyant la transcription aux lunettes. Son entreprise a créé le logiciel et l’application qui rendent la connexion transparente.

Rien qu’aux États-Unis, leur premier marché, il y a environ 30 millions de personnes souffrant d’une perte auditive invalidante, a déclaré M. Narang, sans parler des centaines de millions d’autres dans le monde.

« Pour de nombreuses personnes, les aides auditives sont imparfaites et trop chères, et elles ne sont pas en mesure de traiter les sons que vous voulez entendre et d’éliminer les bruits de fond », a-t-il déclaré.

« Il s’agit d’une technologie vraiment innovante avec de nombreuses applications potentielles », a déclaré Tapan Parikh, professeur associé à Cornell Tech et au département des sciences de l’information de Cornell. « Nirbhay a fait preuve d’ingéniosité pour trouver des collaborateurs externes, tant à l’intérieur qu’à l’extérieur de Cornell. »

Narang a contacté Parikh l’année dernière et a réalisé avec lui plusieurs projets d’étude indépendants liés à l’IA et aux grands modèles de langage (LLM). Deux d’entre eux ont inclus un système qui utilise les LLM pour développer des profils de personnes liés aux valeurs et à l’orientation des valeurs, ainsi qu’un générateur activé par l’IA qui peut inclure de la vidéo, de la musique et du texte. Ils ont également travaillé avec une organisation à but non lucratif en Inde sur un outil de cartographie permettant de documenter la vie des communautés pastorales.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

« Il travaille dur et rapidement », a ajouté M. Parikh. « Dès que nous avons une idée, il construit un prototype en quelques jours. »

Narang voit de nombreuses applications pour les lunettes au-delà du cas d’utilisation des sous-titres, pour les personnes souffrant d’un déficit d’attention ou qui apprennent une seconde langue, par exemple.

M. Narang a déclaré que son expérience en tant que boursier Kessler l’été dernier, ainsi que son séjour actuel à la résidence, un programme d’accélération à New York, l’ont aidé à rencontrer les membres de l’équipe, à renforcer ses compétences entrepreneuriales et à faire avancer l’entreprise.

« J’ai développé un esprit de résolution des problèmes et la capacité d’assimiler rapidement de nouveaux éléments », a-t-il conclu.

Légende illustration : Nirbhay Narang ’25 a créé des lunettes intelligentes qui utilisent l’IA pour fournir des transcriptions de conversations en temps réel.

Source : Cornell University – Traduction enerzine.com