Un centre de données en nuage – des milliers de serveurs informatiques dans un seul lieu – peut atteindre la taille d’un terrain de football et consommer autant d’électricité que 40 000 foyers. Or, les centres de données sont essentiels car ils rendent possible la révolution de l’informatique en nuage : "services aux consommateurs, tels que Facebook, Gmail ou Spotify, applications mobiles et services aux entreprises tels que les bases de données clients."

Le projet Eurocloud a adapté la technologie des microprocesseurs à faible consommation, normalement utilisés dans les téléphones mobiles, en l’appliquant sur une échelle beaucoup plus grande. Des mesures préliminaires montrent que l’utilisation de ces technologies permet de réduire les besoins en électricité de 90% par rapport aux serveurs conventionnels.

Ces résultats permettraient de rendre les investissements dans les centres de données plus abordables pour les entreprises européennes et ainsi aider à l’essor d’une industrie nouvelle.

D’ici à 2020, l’univers numérique atteindra 35 zettabytes (1 000 000 000 000 000 Mo) – contre 1,8 zettabyte en 2011 (soit une augmentation de 1844 %). C’est pourquoi, sans innovations telles que la puce et le serveur Eurocloud, l’alimentation et le refroidissement de ces centres de données deviendra une tâche insurmontable pour les entreprises européennes.

Mme Neelie Kroes, vice-présidente de la Commission européenne, a déclaré à ce sujet : « La voracité en énergie des centres de données en nuage est insoutenable à long terme. Le projet de puce Eurocloud s’attaque au cœur du problème de consommation d’énergie. J’espère que la poursuite du développement de la puce Eurocloud renforcera la position des entreprises européennes dans un secteur actuellement dominé par des non Européens.»

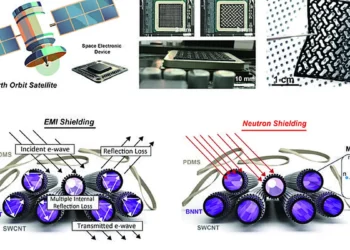

Eurocloud a pour objet de mettre au point des puces pour serveurs qui coûteront dix fois moins à l’achat et consommeront 10 fois moins d’énergie en mode fonctionnement, par rapport aux serveurs actuellement disponibles. Cette invention permettra d’intégrer des centaines de cœurs de microprocesseurs dans un serveur unique, rendant possible dans le futur la création d’un centre de données comportant 1 million de cœurs de microprocesseurs. La mise au point du serveur sur puce 3D permettra de construire des centres de données super-efficaces, écologiquement propres et compacts, à mêmes d’offrir des services en nuage «verts» en Europe.

Le projet de serveur Eurocloud vise plus particulièrement à rassembler des cœurs de processeur et des mémoires à faible consommation d’énergie dans un environnement proche et en trois dimensions. L’accès aux mémoires sur puce requiert une quantité nettement moindre d’énergie, puisque les distances physiques entre les composants sont raccourcies et que les électrons ont moins de «jonctions» à franchir entre la mémoire et le processeur. Le projet a également porté sur la conception d’outils d’analyse des coûts totaux de possession (CTP) des centres de données, qui aideront les personnes chargées de la planification des centres de données ou de la conception de serveurs à évaluer rapidement les incidences financières de leurs décisions sur toute la durée de vie du centre de données.

Ce projet qui associe des chercheurs du Royaume-Uni, de Belgique, de Suisse, de Finlande et de Chypre (NDLR : où est la France ?) a bénéficié d’un financement de l’UE de 3,3 millions d’euros sur 3 ans (2010, 2011, 2012), soit 63% du budget total de 5,4 millions d’euros.

Les domaines de recherche spécifiques du projet sont les suivants:

►Virtual Prototype Specifications of 3D Servers: allant au-delà des puces classiques bidimensionnelles, le projet explore la troisième dimension pour des puces pour serveurs utilisant des microprocesseurs et une mémoire intégrée «à consommation réduite» ("3D stacked server chips");

►Characterisation of Cloud Applications: l’exécution de logiciels sur des centres de données en nuage présente des caractéristiques nouvelles et nécessite des plateformes serveurs spécialement optimisées. Le projet consiste à mesurer et à analyser le comportement des applications en nuage afin d’orienter la conception de la puce pour serveur.

►Scalable 3D Architecture Specifications and Power Management: les puces pour serveur destinées au «nuage» doivent être à la fois à l’épreuve du temps et à basse puissance. Le projet se concentre sur les techniques requises pour atteindre ces deux objectifs.

►On-chip Hierarchies and Interconnects: une puce pour serveur à trois dimensions offre une plus grande quantité de mémoire. Dans le cadre du projet sont définies de nouvelles méthodes pour organiser cette quantité accrue de mémoire sur puce et accéder à cette mémoire.

►Reliability, Availability and Fault Tolerance: le projet porte sur les mécanismes nécessaires pour répondre à la difficulté majeure que présente le fonctionnement 24h sur 24 et 7 jours sur 7 des serveurs dans les centres de données.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

J’étais réticent à cliquer l’article et j’ai eu du mal à le lire. Bon ! sans doute sortira-t-il de ce bazar des specs ou des normes intéressantes sur le long terme. Quant à résoudre les problèmes auxquels il prétend s’attaquer, je préfère m’intéresser à la littérature Google, Intel, ARM, Western Digital, Seagate voire les opportunistes du flash nand comme STM mais là j’ai un peu l’impression de lire « les datacenters pour les nuls » ou le rapport de stage qui a permis à un étudiant d’obtenir une bourse de recherche. Mais soyons honnètes : le budget est accordé pour que l’europe ait son mot à dire dans le déploiment des datacenters, c’est une motivation politique qui cherche à garder une peu de contrôle et de parts de marché. Les motivations environnementable du genre « le CPU 3D raccourcit les connexions et la mémoire flash limite les jonctions » c’est un peu léger si on considère que les CPU auto-limitent leurs fréquence voire se mettent en veille partielle pour tenir leur enveloppe thermique depuis 4 ou 5 ans déjà et qu’Intel a déjà mis des composants en 3D dans ses ivy-bridge. Le problème de consommation des composants est complètement lié à la dissipation thermique plutôt qu’à la proximité de la mémoire flash qui est par ailleurs limitée en nombre de cycles d’écriture… Cela confirme mes réticences initiales mais je souhaite quand même bonne chance au projet pour essayer de limiter l’invasion américaine et asiatique dans nos systèmes d’information , nuageux comme terrestres

quel beau publi reportage pour ARM (société anglaise) l’angleterre qui récupère des fonds européens, sans vouloir assumer ses charges dans l’europe!) tout ce qui est décrit ici n’est pas nouveau! c’ est seulement du rattrapage technologique! je n’aime pas Intel, mais les puces 3D, le cloud, la fiabilité etc, etc, c’est déjà là depuis des années, mais il est vrai pas encore avec ARM qui essaye de rattraper son retard et prendre des part de marché dans les serveurs. si déjà les responsables IT n’avaient pas écouté le marketing invasif et les sirènes brouzoufiènnes d’Intel et choisi à la place les processeurs d’AMD à leur sortie, la consomation des data centers ou du cloud serait déjà plus basse! le problème se situe dorénavant au niveau des capacités de production en gravures inférieures à 22nm . le droit d’entrée pour une nouvelle « fab » sub 22nm se situe entre 5 et 10 Millards de dollars. cela implique une certaine puissance financière, dont ne dispose et ne disposera pas ARM de sitôt surtout avec un budger de 6 Millions d’euros, qui certe comme le dit lionel_fr bénéficiera à quelques étudiants qui une fois formés et performants, se verront certainement offrir la possibilité de doubler leur salaires dans des sociétés hors europe! mon discours n’est pas défaitiste, mais seulement un constat. et quand on publie le minimum serait d’essayer de vérifier que la nouveauté annoncée en est bel et bien une et ne pas publier un « press release » tel quel sans commentaires.

Je savais bien que j’avais vu ça en mai dernier : En fait, ARM ne présente pas de handicap particulier pour les serveurs, il a même un avantage sur Intel grace à son architecture Risc native (celle d’intel est scalaire avec une couche cisc supplémentaire). Le vrai problème est logiciel. Tant qu’on reste dans l’open source , les recompilations suffisent souvent même si ce n’est pas toujours très simple, mais dés qu’on entre dans le propriétaire c’est une autre histoire. Certes la majorité du soft serveur est écrite en C/C++ mais Intel a quand même un avantage historique évident et il n’est pas forcément très excitant pour un Oracle ou un SAP de porter toute sa suite sur des serveurs ARM dont la culture est essentiellement open-source et bas de gamme. Au bon vieux temps des ultrasparcs et autres powerPC’s les architectures se battaient à peu près sur le même terrain mais ARM a surtout fait carrière sur systèmes embarqués ce qui est un bon point pour la consommation mais pas vraiment pour la culture « serveur » Un gros point pour ARM sera MS Server 2008 qui va vraiment faire la révolution et lancer les hostilités du moins c’est l’hypothèse avancée par la presse. Mais je pense aussi que les vieux éditeurs sont très conservateurs et qu’ils se fichent pas mal que leur soft ne tourne pas sur des machines bas de gamme vu le prix qu’ils le vendent (avez vous une idée de ce que coute un système oracle pour 1000 utilisateurs?) Sinon pour ce qui concerne AMD, je crains qu’il ne soit pas vraiment dans la course en ce qui concerne la consommation ni la puissance , AMD se débat dans le bas de gamme en baissant ses prix à chaque annonce Intel depuis 5 grosses années. Il ne propose pas de concurrent sérieux aux core iX ni aux XEON’s maais par contre il garde un avantage certain sur les cores GPU même s’il n’a pas réussi à intégrer ses radeon’s aussi bien qu’Intel depuis les Sandy bridges.. Les puces radeon restent dans le haut du classement avec une consommation imbattable même par son principal compétiteur NVidia Au final, ARM devrait faire un carton , tout le monde s’accorde là dessus , il y a un marché énorme pour les petits serveurs et Atom n’est pas vraiment conçu pour cet usage (mais Intel est en train de faire son enième virage sur ce point) Tant mieux pour les cortex , tant pis pour les vieux x86 qui garderont quand même une place imprenable dans le propriétaire et le haut de gamme et un couteau entre les dents pour garder leur place de no1

attention lionel_fr a ne pas reproduire la propagande Intel, sans vérifier! ni la propagnade ARM d’ailleurs! depuis plus de 5 ans, la part cisc des processeurs x86 X64, aussi bien chez Intel que chez AMD est minime par rapport a la part risc donc cet argument d’ARM ne tient vraiment pas la mémoire des caches, représente de plus en plus la plus grosse part de la puce! la recompilation ! justement c’est la le problème il y a autant de variantes ARM que de fabricants, même avec le même coeur et aussi parceque les différents coeurs ne sont pas forcéments compatibles! quel est l’utilisateur final qui recompile son application suivant la cible sur laquelle elle doit tourner? la consommation ARM est basse, parceque les performances sont basses, avec les process actuels, si vous abaissez les performances x86 X64 au niveau des ARM ils ne consomment pas plus. qu’AMD se débatte, c’est vrai, mais ce n’est pas sur le terraindes performances, mais plutot sur le terrain du marketing « financé » Intel est arrivé en position de monopole (ceci à été jugé, au japon en corée, en europe et aux états-unis) en obligeant via des contraintes de livraison de leur dernières puces leurs clients à ne pas commander d’AMD ce sont des pratiques commerciales illégales pour lesquelles ils ont payé moins de 2 milliards de dollars pour arrêter les poursuites judiciaires ce qui est très peu par rapport aux bénéfices qu’ils ont réalisés! vous oubliez qu’AMD à été le premier a offrir un processeur 64 bit compatible X86 les premiers controleurs mémoire intgrés, les premiers multicoeurs X86 commerciaux aujourd’hui 16 cores et dernièrement l’intégratin de puces graphiques haut de gamme pour lequelles Intel n’est pas encore arrivé à la cheville au niveau des performances graphiques, même en utilisant un process de gravure plus fin. ARM prendra certanement quelques part de marché, mais mon intervention concernait 1. la non innovation car déjà fait et 2. la somme dérisoire qq millions d’euros de la recherche sur fonds européens face aux investissement colossaux de R&D de leurs compétiteurs!

c’est bien de réduire à l’avenir de 90%, mais commençons maintenant. Quid de la clim solaire, peut-elle être appliquée?

Ok vous n’aimez pas Intel. Je ne lui porte pas non plus un amour fou m’enfin dans ce business , rares sont ceux qui cumulent position dominante et affectif Oui Intel a triché, ce qui ne l’empèche pas de régner avec des solutions discutables en termes de perfs mais toujours 2 ou 3 générations d’avance. En l’occurrence, les x86 d’intel assurent la compatibilité maximum des jeux d’instruction grâce à une couche de micro-code qui convertit le code machine 86 en code risc. Cette architecture est apparue avec le 486 au début de 90’s Avantages multiples en terme de compatibilité mais pas en terme de perf car le microcode doit s’exécuter alors que le code ARM est cablé natif. C’est ça le hic. Mais quel hic : à chaque amélioration du risc sous jascent, une nouvelle version de micro-code et le résultat est compatible ascendant alors que chez ARM, chaque déclinaison entraine, comme vous le soulignez, des problèmes de compatibilité. On peut voir cette couche comme une nano machine virtuelle pour les amateurs de métaphores. Ainsi , comme pour java , le code executable reste le même , il suffit que la VM soit à jour ce qui est toujours le cas puisque gravé en rom voire cablé en dur dans le die Intel. Le principe a largement prouvé son intéret jusqu’ici , quant à l’embrouille avec AMD , elle est bien réelle et je reconnais volontiers qu’AMD a cartonné en son temps sur le 64bits mais depuis les Core 2 Duo , on n’a plus vu AMD inquiéter Intel en terme de puissance par watt dissipé. Or cette puissance par watt est exactement le critère autour duquel l’article et l’équation énergétique des datacenters s’articule. Si les résultats étaient voisins, je ne dirais rien , mais là on nage dans un océan d’intel et AMD qui patauge dans les desktops bon marché. Je vous dis ça sans état d’ame particulier , j’aimerais aussi qu’AMD marque des points mais en x86 il est largué. Comme je développe des solutions CUDA-OpenCL j’apprécie en revanche le retour en force de AMD-Radeon face à NVidia où la consommation est, en revanche, complètement à l’avantage d’AMD mais en tant que développeur , je ne vois aucune probabilité pour que le GPGPU s’impose jamais dans les serveurs. La question des serveurs est d’ailleurs intéressante, il n’y a pas de calcul hyper-maousse à faire. Il faut surtout gérér des file-system et stack TCPIP , faire tourner du scripting et des databases. Tout ce qui relève de bus plus large, cache plus important aura beaucoup plus d’effet sur leur conso que le calcul flottant qui n’influe pratiquement pâs du tout. Les serveurs sont des machines de telecom, les supercalculateurs sont plus scientifiques. Les telecom profitent plus du nombre de core/threads, largeur et qualité de multiplexage bus, vitesse des cache…. Quoi qu’on en dise , un gros serveur consommera toujours moins que plusieurs petits car router de l’IP est plus couteux que partager des bus natifs.. C’est là qu’Intel ne peut être inquiété , sa puissance par watt est meilleure qu’AMD mais légèrement moindre qu’ARM. Mais ARM n’a pas de haut de gamme alors que le très cher et très puissant XEON n’a pas de concurrence. Maintenant si on regarde l’offre d’hébergement on comprend tout de suite que le mutualisé et le serveur dédié sont deux marchés différents et c’est pour cette raison qu’ARM va prendre le dessus. C’est les petits serveurs dédiés (KIMSUFI chez OVH) qui lui donnent un segment de marché adapté à sont profil

encore une fois le marketing d’intel vous a imposé leur pensée u (i?)nique. 2 ou 3 générations d’avance en production, bien sur que non! regardez les différents test et vous verrez que les performances et la consommation suivants les applications varent autour de 10% les uns par rapport aux autres . 2 ou 3 génération cela se traduirait par un facteur au moins un facteur 2 et une disparition du marché! les histoires de microcode à ce niveau importent peu. tout ces codes sont la plupart du temps exécutés en parralèle et en cache, avant même les résultats de branchement! et d’un autre coté des instructions complexes, utilisent la plupart du temps moins de mémoire que les instructions risc, donc plus consommateur de code! sans parler du flottant! d’autre part AMD est un promoteur des solutions de compilations multicoeur, multi dsp (GPU par exemple) et de plus en plus de code pourra être optimisé via des instruction exécutées par le processeur Graphique ou d’autre processeurs spécialisés, vidéo, son, voix, ou calcul d’adresse de bases de comme dans les mémoires accessibles par les données, (grosse demande de calcul) regardez donc cette annonce « vieille » de 15 jours et dites moi la différence. AMD utilise même de l’intel chez Seamicro qu’ils ont racheté pour leur savoir faire micro serveurs, mais peut être juste pour montrer qu’ils peuvent offrir 512 coeurs avec 64 processeurs alors que la version Intel n’en propose que 256 dans le même volume! vous disiez 2 ou 3 générations ;o) pas encore. et en tous cas certainement bien meilleur pour le porte monnaie de votre entreprise de choisir des solutions AMD ;o)

Ok vous êtes aveuglé par l’affectif et c’est plutot sympa qu’AMD ait des supporters prets à tuer ou plutot à sacrifier leur job parce que trop fan pour défendre leur projet au détriment de leur fondeur-poulain. Intel n’a pas que deux G d’avance : il fond lui-même ses puces dans une dizaine de pays, une partie de sa R&D est co-financée par le dept d’état, équipe les agences gouvernementales genre NASA avec d’autres comme IBM ou Digital (DEC) ou motorola…. AMD sous-traite la fab en corée du sud. On ne parle pas de la même chose même s’ils sont supposés en concurrence loyale , ils ne le sont certainement pas puisque Intel est implanté un peu partout chez les pays US friendly alors qu’AMD attend après TSMC ou Global foundries ou dieu sait quel sous-traitant pour annoncer ses specs. En termes de consommation ou efficacité ou performance par watt (sujet de l’article) la place d’Intel est définitivement inaccessible aux secondes sources , AMD inclus. Ensuite , le GPGPU n’est d’aucune utilité dans les datacenters, ce qui clôt la question, vous me parlez de DSP , or je vous disais justement qu’on ne parle pas de calcul ici mais de serveurs orientés telecom. Quand au µcode , parlez pour vous ! si vous ne descendez pas plus bas que java ou visual basic , c’est vrai peu de différence , sauf qu’AMD chauffe abominablement. Pour rester sur le sujet de l’article, les questions énergétiques ont été intégrées dans la gamme intel avec une percée très nette des atom alors qu’AMD commence tout juste à le faire en changeant légèrement ses modèles « M »obiles. Le seul hyper-threading constitue une économie d’énergie très signifiante. AMD n’a que 4 modèles de core mis à jour une fois tous les xx mois, un peu plus de ceci , un peu moins de cela … Le truc c’est que je ne fais pas trop dans la catégorie « j’aime » en matière de CPU. Les AMD ont toujours chauffé et consommé beaucoup même si on s’en fiche sur un desktop bien ventilé, c’est extrèmement signifiant dans l’industrie dont la plupart des intervenants n’a jamais utilisé un AMD de leur vie Ensuite , si vous touchez un peu au C / C++ ASM et éventuellement à OpenCL , vous allez vite comprendre le gouffre Ca montre que le monde des geeks est rempli de conflits aussi stupides que les pronukes vs EnR . Sauf que là le leader assure vraiment contrairement au nuke, bon.. David et goliath , c’est une histoire biblique , pas de l’histoire contemporaine

Ah ! J’ai oublié de vous coller ce lien , juste histoire de mettre les choses au clair sur qui fait le haut de gamme et qui fait de le buzz : tout est dans le nom :

Liooooooonel pas OK, vous êtes aveuglé par le marketing et c’est plutôt triste, de voir agir certain comme des moutons de Panurge et se faire berner au point de mettre en danger leurs entreprises en ne choisissant pas les meilleurs solutions en performance/prix ;o) (voir plus bas) A vous lire il semblerait que vous ne connaissiez pas les circuits de fabrication mondiaux des puces électroniques. certe intel utilise ses fabs (dailleurs le premier grand patron d’AMD avait dit il y a une quinzaine d’année « only real men have fabs »! mais depuis les choses ont bien changé. les 5 premiers Fabless (dont AMD et qualcom, broadcom, nvidia, marvell) ont un CA de plus de 30 milliards de dollars, les 25 premiers plus de 50 Mds et tous ensembles plus de 60 milliards! (une paille!) AMD ne sous-traite pas en Corée du sud, mais essentiellement au niveau de TSMC (Taiwan semi co!) en plus de global foundries, ses anciennes fab. vous soutiendriez que TSMC ne serait pas US friendly!?!vous netrouverez personnes pour supporter cette thèse AMD travaille aussi en collaboration avec IBM et d’autre fabricants sur les futurs process (sub 20nm) ainsi bien sur qu’avec les fondeurs pour fabless! et aussi avec les agences de l’état US: exemple » July 11th 2012– AMD today announced that it was selected for an award of $12.6 million for two research projects associated with the U.S. Department of Energy’s (DOE) Extreme-Scale Computing Research and Development Program, known as « FastForward. » ensuite, il faut peut être essayer de lire et comprendre les liens que vous me conseillez de lire, AMD chaufferait abominablement! c’est certainement pour cela qu’Intel prépare (c’est à dire qu’il n’ont aujourd’hui rien d’éqyuivalent!) un processeur avec un tdp de inférieur à 17W! (voir plus bas) la multiplicité des cores différents, n’est pas un gage de rationalisation de la R&D! surtout quand cela oblige à développer les compilateurs optimisé pour chaques familles! Quand vous dites que l’industrie n’utilise pas AMD, vous ne connaissez pas les versions embedded proposées par AMD qui est dans tous les marchés depuis plus de 20 ans en garantissant au minimum 5 ans de production ce qui de nos jours est un must!) et même les militaires, ce qui implique support et fiabilité. je ne suis pas un geek, j’ai vécu cela de l’intérieur et je parle en connaissance de cause, pas en lisant ou reproduisant wikipédia. il est toujours plus facile de se cacher derrière un goliath que d’essayer de comprendre les avantages d’un David. il suffit de prendre du recul et d’analyser soi-même les informations, et de ne pas suivre le « pré-maché » markting des puissants. pour votre info par exemple: en prenant le lien de votre post ci dessus: 1er i2600K perf: 9.071 prix: 299,99 2èmes i2600 perf: 8.882 prix: 294,98 3ème AMD FX8120 perf: 7.040 prix: 155,95 rapport prix/performance ce qui importe au final, c’est de dépenser lemoins possible pour la puissance dont on a besoin non? 1er AMD 22,15 2ème Intel2600K 33,07 soir 50% plus cher qu’AMD à perf égale! 3ème intel2600 33,21 kif kif aussi cher! CQFD, merci pour le lien ! l’overclocking est un bon indicateur de la robustesse du design news du 29 septembre 2012: « Cela se confirme, l’A10-5800K d’AMD Trinity s’overclocke extrêmement bien, et vendu environ 150 $, ce CPU monte facilement à 6,50 GHZ grâce à du LN2 (Azote Liquide), et de façon stable. » pour des processeurs qui en version refroidie classiquement tourne 2 fois moins vite! news du 27 septembre 2012 (pas trop vieux, non?) » Intel a révélé travailler sur de nouveaux CPU Pentium ULV qui seront basés sur l’architecture Ivy Bridge, et bien la firme va commencer sa propagande en les comparant aux derniers ULV d’AMD basé sur l’architecture Trinity. » en TDP17 Watts et si vous regardez l’article associé, Intel n’a même pas peur d’annoncer que les benchmark utilisent des versions de test optimisées pour les processeurs Intel! Merci d’écouter ceux qui connaissent vraiment ;o) et ne vous laissez pas avoir par la propagande. et surtout si vous voulez voir progresser vos machines, permettez à AMD de montrer les qualités de sa production et de sa proposition commerciale. vous soignerez par là même vos budgets!

Ok , je me suis trompé de bench, je vous ai mis les desktop alors qu’on parlait de serveurs !! Voici le bon : Je ne vais pas épiloguer sur l’amour que vous portez à AMD et sincèrement , j’espère qu’il parviendra a gagner des parts de marché. Je voulais essayer de mettre l’accent sur le caractère professionnel de l’activité serveur, ce qui ne semble pas vous contrarier dans votre évangile. Anyway l’article parle de conso d’énergie dans les serveurs. C’est donc de ce point qu’il faut traiter, un gros revers pour Intel serait le recentrage de MS vers ARM et qu’AMD réussisse mieux ses APU ARM que ses x86 Bon, en l’état , votre magnifique enthousiasme pour AMD ne fera pas grande différence dans les serveurs , j’héberge personnellement des serveurs Intel et je ne saurais jamais si AMD est mieux car je n’en commanderai pas pour cet usage. En revanche , je crois qu’OVH (qui héberge enerzine) proposait des machines dédiées sur AMD il y a quelques années. Exactement le marché que vise ARM . Mais j’ai du mal à comprendre pourquoi vous insistez sur AMD dans le cadre de cet article alors qu’il n’est question que de consommation electrique Or la conso est le point faible d’AMD , ce n’est pas une cata , c’est juste pas le bon article pour vanter les mérites de votre boite. Personnellement , je ne prends que du Xeon, du core i7 et de l’atom et aucun AMD ne les concurrence sérieusement , pas de bol ! En revanche mes systèmes cibles sont souvent des ARM 7 et cortex a 9. Et ça doit être un manque de chance horrible mais à chaque fois que je dois chercher autre chose (openCL par ex..) AMD est absent de tous les catalogues et encore moins de bol mon environnement de dev ne supporte pas AMD, c’est une conspiration ! Pour prétendre challenger les systèmes pro, il faut déjà entrer dans les catalogues et proposer des outils de dev… sinon ben rien, AMD n’existe pas vu d’ici et vu leurs problèmes de chiffre , je doute qu’ils investissent gros pour entrer sur des plateformes National Instruments, re manque de bol. C’est une malédiction décidément.. Vous croyez que je vais modifier et recompiler 7 millions de lignes de code pour essayer de changer un peu de fournisseur pour voir ? vous croyez que ça marche comme ça ?

J’ai oublié de dire : Intel pourrait doubler ses prix et AMD les diviser par cinq ! ce n’est pas vraiment le problème d’un cargo de 15000 tonnes d’économiser 200€ sur la logique de son moteur d’étrave … Les économies dont vous parlez n’appartiennent pas à mon monde Dans les serveurs , c’est pareil sauf pour les petits dédiés qui sont loués à l’année, c’est le marché actuel d’ARM , ces machines souvent sous employées, permettent à de nombreux constructeurs de solutions moins énormes que les xeons de trouver un marché très prometteur Leur multiplication entraine un surcroit de consommation mais , il s’avère que les hébergeurs ne répercutent pas la consommation electrique à leurs clients c’est sûrement cet argument qui clôturera cette question et Enerzine le sait mieux que personne (*ovh vous fait il payer la consommation ou le refroidissement ? non bien sur) donc à quoi bon économiser puisque l’électricité est gratuite ! En revanche si on dépasse la bande passante allouée , on paye un supplément mais les datacenters n’ont pas la logique pour facturer autre chose que des prestations strictement *it et l’electricité n’en fait pas partie ou plutôt elle est forfaitisée dans l’offre standard (pour un montant très faible évidemment) Allez , Bonne chance à AMD , la seule seconde source au monde pour les x86, sans lui , le monopole serait total !!!! Sa performance est donc très appréciable

décidément ! vous semblez ne pas vouloir voir la vérité en face. votre nouveau lien démontre la même chose l’optéron de la liste a un rapport prix sur perf de 60 et le premier de la liste l’intel un rapport de 122! soit 2 fois plus cher pour la même performance ou 2 fois moins de performance pour le mêm prix! je vous disais bien qu’AMD était un meilleur investissement! et le processeur AMD mentionné est déjà ancien vous parlez de serveurs et ne semblez pas avoir lu le lien précedent sur Seamicro un autre de Reuters vous paraitrait-il plus sérieux! obligé de supprimer des liens! voir aussi: les annonces du linley group pour vous informer de l’intérêt d’AMD dans les seveurs (en 2011) Concernant OpenCL. avez-vous bien cherché pour ne pas trouver celui-ci: assez d’outils? Mode énervé ;o(( il faut arréter de regarder dans les catalogues office dépot ou metro, quand on prétend faire de « l’informatique » et au moins surfer sur les sites des fabricants. mode revenu au calme ;o) Vous semblez raisonner sur des idées ou des informations assez anciennes, je ne travaille pas chez AMD, mais je suis leur évolution depuis longtemps et le rapport qualité prix offert est supérieur. que le support soit faible en France est une autre histoire, qui n’a rien a voir avec la valeur intrinsèque de l’offre Intel a malheuresuement des moyens promotionnels très supérieurs et c’est nécessaire! vu les prix élevés qu’ils proposent