Les robots modernes sont capables de percevoir leur environnement et de répondre au langage humain, mais il est essentiel de leur apprendre à demander de l’aide pour les rendre plus sûrs et plus efficaces. Découvrez comment des ingénieurs de l’Université de Princeton et de Google ont développé une nouvelle méthode pour y parvenir.

Les ingénieurs ont mis au point une technique qui consiste à quantifier l’incertitude du langage humain et à utiliser cette mesure pour indiquer aux robots quand demander des instructions supplémentaires. Afin d’y parvenir, ils utilisent de grands modèles de langage (LLM), comme ChatGPT, pour évaluer l’incertitude dans des environnements complexes.

Anirudha Majumdar, professeur adjoint en ingénierie mécanique et aérospatiale à Princeton et auteur principal de l’étude, souligne que les sorties des LLM sont encore souvent peu fiables. Il est donc crucial que les robots basés sur les LLM sachent quand ils ne savent pas.

Définir un seuil d’incertitude pour demander de l’aide

Le système permet également à l’utilisateur de définir un degré de réussite cible, lié à un seuil d’incertitude particulier qui amènera le robot à demander de l’aide. Par exemple, un robot chirurgical aura une tolérance à l’erreur beaucoup plus faible qu’un robot nettoyant un salon.

Allen Ren, étudiant diplômé en ingénierie mécanique et aérospatiale à Princeton et auteur principal de l’étude, explique que l’objectif est de minimiser la quantité d’aide dont le robot a besoin tout en atteignant le niveau de réussite souhaité par l’utilisateur.

Des tests prometteurs sur des robots réels et simulés

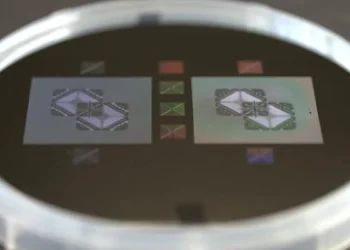

Les chercheurs ont testé leur méthode sur un bras robotique simulé et sur deux types de robots dans des installations de Google à New York et Mountain View (Googleplex), en Californie. Les expériences les plus complexes ont impliqué un bras robotique monté sur une plateforme à roues et placé dans une cuisine de bureau.

En utilisant une approche statistique appelée prédiction conforme et un taux de réussite garanti spécifié par l’utilisateur, les chercheurs ont conçu leur algorithme pour déclencher une demande d’aide humaine lorsque les options atteignent un certain seuil de probabilité.

Les défis futurs pour les robots et la perception active

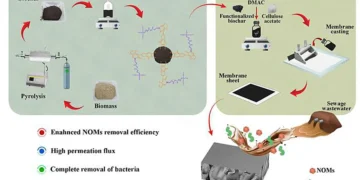

Allen Ren travaille actuellement sur l’extension de cette méthode aux problèmes de perception active pour les robots, comme l’utilisation de prédictions pour déterminer l’emplacement d’objets dans une maison lorsque le robot se trouve dans une autre partie de la maison. Cette opération nécessite un planificateur basé sur un modèle qui combine des informations visuelles et linguistiques, soulevant de nouveaux défis pour estimer l’incertitude et déterminer quand déclencher l’aide.

En synthèse

En enseignant aux robots à demander de l’aide lorsqu’ils sont confrontés à l’incertitude, les ingénieurs de l’Université de Princeton et de Google ont développé une méthode prometteuse pour améliorer la sécurité et l’efficacité des robots. En utilisant des grands modèles de langage et la prédiction conforme, cette approche pourrait contribuer à résoudre les défis futurs liés à la perception active et à la collaboration entre les robots et les humains.

Pour une meilleure compréhension

Qu’est-ce que les grands modèles de langage (LLM) ?

Les grands modèles de langage (LLM) sont des outils technologiques utilisés pour évaluer l’incertitude dans des environnements complexes. Ils sont utilisés pour aider les robots à comprendre et à répondre au langage humain.

Comment les robots peuvent-ils demander de l’aide ?

Les robots peuvent demander de l’aide en utilisant une mesure d’incertitude basée sur le langage humain. Lorsque cette mesure atteint un certain seuil, le robot est programmé pour demander des instructions supplémentaires.

Qu’est-ce que la prédiction conforme ?

La prédiction conforme est une approche statistique utilisée pour déclencher une demande d’aide humaine lorsque les options d’action d’un robot atteignent un certain seuil de probabilité.

Quels sont les avantages de cette nouvelle méthode ?

Cette nouvelle méthode permet d’améliorer la sécurité et l’efficacité des robots en leur apprenant à demander de l’aide lorsqu’ils sont confrontés à l’incertitude. Elle permet également de minimiser la quantité d’aide dont le robot a besoin.

Quels sont les défis futurs pour les robots ?

Les défis futurs pour les robots comprennent la perception active, comme l’utilisation de prédictions pour déterminer l’emplacement d’objets dans une maison lorsque le robot se trouve dans une autre partie de la maison. Cela nécessite un planificateur basé sur un modèle qui combine des informations visuelles et linguistiques.

Principaux enseignements

| Enseignements |

|---|

| Les robots modernes peuvent percevoir leur environnement et répondre au langage humain. |

| Une nouvelle méthode a été développée pour enseigner aux robots à demander de l’aide lorsqu’ils sont confrontés à l’incertitude. |

| Cette méthode utilise de grands modèles de langage (LLM) pour évaluer l’incertitude dans des environnements complexes. |

| Un système permet à l’utilisateur de définir un degré de réussite cible pour le robot. |

| La prédiction conforme est utilisée pour déclencher une demande d’aide humaine lorsque les options d’action d’un robot atteignent un certain seuil de probabilité. |

| Les chercheurs ont testé leur méthode sur un bras robotique simulé et sur deux types de robots dans des installations de Google. |

| Les défis futurs pour les robots comprennent la perception active, comme l’utilisation de prédictions pour déterminer l’emplacement d’objets dans une maison. |

| Cette nouvelle méthode pourrait contribuer à résoudre les défis futurs liés à la perception active et à la collaboration entre les robots et les humains. |

Références

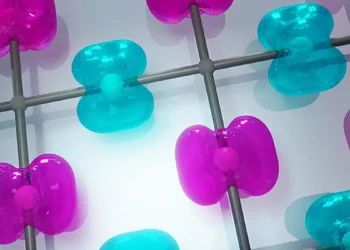

Légende illustration principale : Des ingénieurs de l’université de Princeton et de Google ont trouvé un nouveau moyen d’apprendre aux robots à savoir quand ils ne savent pas et à demander des éclaircissements à un humain. Photo des chercheurs

L’article, intitulé « Robots That Ask for Help : Uncertainty Alignment for Large Language Model Planners« , a été présenté le 8 novembre à la conférence sur l’apprentissage robotique. Outre Ren, Zeng et Majumdar, les coauteurs sont Anushri Dixit et Alexandra Bodrova de Princeton, ainsi que Sumeet Singh, Stephen Tu, Noah Brown, Peng Xu, Leila Takayama, Fei Xia, Jake Varley, Zhenjia Xu et Dorsa Sadigh de Google DeepMind. La recherche a été soutenue en partie par la National Science Foundation des États-Unis et l’Office of Naval Research.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.