Les ordinateurs quantiques ne sont pas encore totalement fiables – ils sont bien trop instables. Cependant, partout dans le monde, des chercheurs tentent de les améliorer – certains sont basés en Norvège.

« Dans les ordinateurs quantiques, l’information est transmise et stockée à l’aide de qubits (bits quantiques). Mais l’information quantique peut être rapidement perdue », explique Jeroen Danon, professeur au Département de physique de l’Université norvégienne de sciences et de technologie (NTNU).

L’un des principaux problèmes est qu’il est difficile de déterminer à quelle vitesse l’information est perdue.

Pas de méthode de mesure précise

« Dans les qubits supraconducteurs largement utilisés, le temps nécessaire à la disparition de l’information est, en moyenne, raisonnable. Mais il semble varier aléatoirement dans le temps », précise Danon.

Il est donc vraiment regrettable que nous n’ayons même pas de méthodes de mesure rapides et fiables pour déterminer combien de temps il faut avant que l’information dans les qubits ne soit perdue. Il est bien sûr absolument nécessaire de résoudre ce problème pour pouvoir faire fonctionner les ordinateurs quantiques de manière plus stable qu’actuellement.

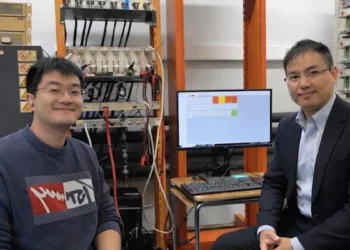

Danon et ses collègues ont maintenant trouvé une solution.

« En collaboration avec une équipe internationale dirigée par l’Institut Niels Bohr de Copenhague, nous avons développé une nouvelle méthode de mesure. Elle nous permet de mesurer le temps nécessaire à la perte d’information avec une rapidité et une précision inégalées », affirme Danon.

100 fois plus rapide

Auparavant, il fallait environ 1 seconde pour mesurer le temps avant que l’information ne disparaisse. Dans ce contexte, c’est un temps très très long.

Newsletter Enerzine

Recevez les meilleurs articles

Énergie, environnement, innovation, science : l’essentiel directement dans votre boîte mail.

« Nous avons réussi à le faire en environ 10 millisecondes, soit plus de 100 fois plus vite. Et plus ou moins en temps réel », souligne Danon.

En conséquence, ils peuvent surveiller la perte d’information beaucoup plus précisément au moment où elle se produit. De plus, ils sont capables d’observer de petits changements rapides qui étaient auparavant invisibles.

« Cela facilitera à son tour l’identification des causes sous-jacentes qui font disparaître l’information », explique-t-il.

Les résultats de la recherche changent la façon dont nous devrions calibrer et tester les processeurs quantiques, nous permettant d’en apprendre davantage sur les processus microscopiques qui limitent les performances des ordinateurs quantiques actuels. Et c’est une bonne nouvelle.

Article : Real-time adaptive tracking of fluctuating relaxation rates in superconducting qubits. – Journal : Physical Review X – Méthode : Experimental study – DOI : Lien vers l’étude

Source : NTNU